După înfrângerea (la limită!) a Partidei Ruse la alegerile prezidențiale din acest an și după punerea sub acuzare a lui Călin Georgescu, propaganda rusească și acțiunile agenților de influență pe care-i are Rusia în România au cunoscut câteva etape de reorganizare, ajustare și ulterior, de relansare a ofensivei de dezinformare prin care Putin încearcă să prăbușească democrația în țara noastră.

Această ofensivă face parte dintr-un efort continental al serviciilor de informații ale Federației Ruse care au reușit să conceapă și să implementeze un mecanism extrem de eficient de manipulare a opiniei publice din România și din țările membre ale Uniunii Europene.

În România, victoria înregistrată de Moscova în lupta informativă a fost aproape totală – puțin a lipsit ca țara noastră să fie capturată de un regim pro-Rusia, anti-UE, anti-NATO – și efectiv a umilit serviciile secrete generos stipendiate de statul român: SRI, SIE, DGIA (serviciul secret al Armatei Române), STS etc.

Cauzele acestei înfrângeri le vom analiza separat. Consemnăm, deocamdată, faptul că în România, Rețeaua „Matryoshka” a reușit să transforme peste 5 milioane de români (aproximativ un sfert din populația țării!) în niște dușmani asumați ai democrației, ai statului de drept și ai parcursului european al României.

O victorie extraordinară a Rusiei putiniste, din păcate, și care merită notată la excepțional într-un manual al tehnicilor de manipulare folosite de serviciile secrete pentru a obține controlul unor mulțimi imense de cetățeni ai unui stat considerat inamic.

Ce este Rețeaua „Matryoshka”?

Denumirea de „Matryoshka” face trimitere la vestitul set de păpuși din lemn rusești cu același nume.

Un set de „Matryoshka” este format din mai multe păpuși din lemn, goale înăuntru, care se introduc una în cealaltă, de la cea mai mare până la cea mai mică. Aceste păpuși din lemn ar fi apărut la sfârșitul secolului XIX, la Abramțevo (un sat și moșie nobiliară la nord de Moscova), dar au fost produse pentru prima oară în serie și cantități masive în orășelul Serghiev-Posad, din Regiunea Moscova.

Păpușile „Matryoshka” ne vorbesc, indirect, despre spiritul națiunii ruse: au fost inspirate de la ouăle de Paști viu colorate și de la niște figurine japoneze, apoi au fost proclamate ca fiind simbolul fertilității (nașterea din generație în generație de femei). Într-un final, au ajuns să fie identificate cu permanenta lipsă de sinceritate a rușilor (mai ales, a politicienilor sovietici și a celor ruși, după căderea URSS), ca un avertisment că întotdeauna în spatele cuvintelor rostite de un rus se află o altă realitate care și aceasta, la rândul ei, ascunde și este negată de o altă realitate, și tot așa până la epuizarea „matryoshkăi”.

Într-un raport emis în iunie 2024 de VIGINUM (Le Service de Vigilance et de Protection contre les Ingérences Numériques Etrangères), sub sigla Secretariatului General al Apărării și Securității Naționale al Franței, Rețeaua „Matryoshka” desemnează campania pro-rusă lansată asupra zonelor de limbă franceză (și nu numai), prin care sunt vizate mass-media și comunitățile specializate în „fact-checking”.

Acest „nume de cod” a fost atribuit propagandei pro-Rusia de grupul de activiști ruși anti-Putin intitulat „Antibot4Navalny”, care monitorizează, din 2018, activitățile de dezinformare și manipulare instrumentate de regimul de la Moscova.

La originea raportului pe care-l prezentăm se află o amplă acțiune de monitorizare și documentare realizată de VIGINUM spre sfârșitul anului 2023, asupra unei campanii de manipulare instrumentată de Rusia în spațiul online francofon.

Concluzia VIGINUM este că respectiva campanie de manipulare are ca scop să posteze conținut fals („rapoarte”, meme-uri, „graffiti” etc.) în rețelele de socializare (Facebook, Twitter, Instagram etc.), în secțiunea de comentarii la postările conturilor deținute de diferite instituții mass-media, personalități politice și civice, organizații de „fact-checking” etc. din peste 60 de țări francofone.

Conținutul fals are ca finalitate manipularea opiniei publice în favoarea Rusiei lui Putin și împotriva sistemului democratic, a Uniunii Europene, a NATO, a Lumii Libere în general.

Grupul anti-dezinformare „Antibot4Navalny”

„Antibot4Navalny” este grup anonim format în principal din analiști ruși voluntari, adepți ai valorilor democratice mărturisite de eroul luptei pentru libertate în Rusia, Aleksei Anatolievici Navalnîi (asasinat în închisoare la ordinul lui Putin, în 16 februarie 2024). Ei urmăresc operațiunile de influență și manipulare a opiniei publice instrumentate de Rusia în rețelele de socializare (în principal în rețeaua X).

Grupul este activ din noiembrie 2023, dar o parte din membri săi acționează în clandestinitate împotriva propagandei rusești încă din anul 2018.

La începutul activității sale, „Antibot4Navalny” avea ca obiectiv principal analizarea dezinformărilor care vizau situația politică, economică și militară din Rusia și Ucraina, țintele vizate de grup fiind fermele de troli înființate și coordonate de Moscova.

Activitatea grupului a trecut de la nivel regional la o avengură internațională în octombrie 2023. La acel moment, analiștii „Antibot4Navalny” au descoperit o campanie masivă de „boți” coordonată de Moscova, prin care se posta și promova insistent un videoclip în limba rusă care urmărea schimbarea narațiunii rusești despre războiul de agresiune declanșat asupra Ucrainei.

În respectivul videoclip se comunicau cu insistență două narative: primul, că Rusia și Ucraina sunt „state surori”; al doilea, că luptele dintre ucraineni și ruși destrămau marea familie pe care o formau rușii și ucrainenii, care ar fi, de fapt, unul și același popor. Observăm că aceste narative au fost agresiv și masiv distribuite și în România prin intermediul rețelelor de socializare, dar și prin preluarea lor în discursurile unor politicieni români „suveraniști”.

Inițial, Grupul „Antibot4Navalny” a considerat că țintele campaniei erau Rusia și Ucraina. Foarte repede însă, informațiile procurate de analiștii grupului au condus la concluzia că „boții” acționau de această dată cu o rază de acțiune planetară, atacând Franța, Germania, Israelul și SUA.

Scopul real ascuns (prin metoda „Matryoshka”) în spatele unui scop aparent (de a schimba narativul privind războiul din Ucraina) era de fapt să determine opinia publică și mediile politice din țările democratice să nu mai susțină acțiunile guvernelor lor de trimitere de ajutoare financiare, umanitare și militare către Ucraina.

Din acel moment, frontul de luptă susținut de Grupul „Antibot4Navalny” împotriva campaniilor de manipulare instrumentate de Rusia a devenit unul global.

Analiza VIGINUM a modului de operare a Rețelei „Matryoshka”

O campanie de dezinformare instrumentată de Rusia (prin serviciile secrete rusești, ferme de „troli”, agenți de influență din țările-țintă ori prin diferite alte entități controlate de statul rus) vizează diseminarea (prin utilizatori umani sau prin softuri automatizate) pe scară largă, în mod deliberat și organizat, într-o anumită zonă-țintă (către mulțimi mari de persoane sau către anumite categorii de persoane) a unor informații false care contribuie la realizarea intereselor geopolitice pe care le are Rusia în legătură cu un anumit subiect/fenomen/eveniment politic, social, economic, militar etc. în țara-țintă/țările-țintă vizată(e).

Pot fi identificate anumite etape ale acestei campanii de dezinformare tip „Matryoshka” instrumentată în mediul online.

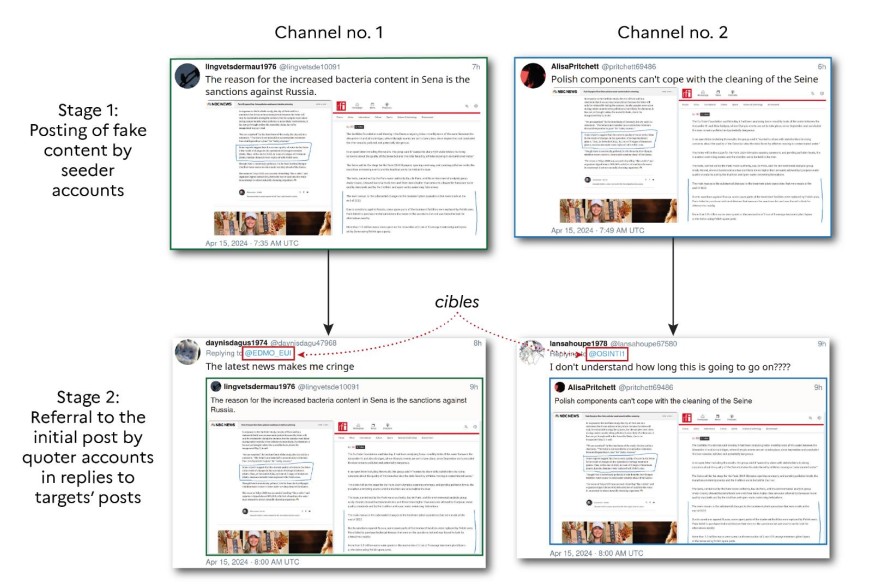

Primul grup de conturi („seeders” – care „plantează” informația falsă) postează conținut fals pe platforma de socializare vizată (în raportul VIGINUM este analizată rețeaua de socializare X – fostul Twitter –, însă tehnica este valabilă pentru oricare altă rețea de socializare).

Al doilea grup de conturi („quoters” – cei care „citează”) distribuie postarea unui „seeder” ca răspuns/reacție/comentariu la postările unor entități mass-media, personalități politice, civice și comunități de „fact-checking”. Același grup promovează postarea confecționată de „seeder” în diferite grupuri/comunități din rețeaua de socializare respectivă, astfel încât, în final, postarea este asumată de persoane reale care nu au vreo legătură directă cu Rețeaua „Matryoshka”, dar care devin parte activă în rețea.

Persoanele reale care preiau conținutul fals, considerându-l adevărat, sunt așa-numiții „idioți utili” și constituie, totodată, grupul-țintă al campaniei de dezinformare.

Specificul unei astfel de campanii de manipulare este acela că folosește chiar grupul-țintă vizat ca parte activă a campaniei. Mecanismul este asemănător modului în care se răspândește un virus: informația falsă distribuită de campania de dezinformare este prezentată astfel încât membrii grupului-țintă o acceptă cu valoare de adevăr (sunt infectați) și aceștia devin, la rândul lor, diseminatori ai informației false respective (purtători și propagatori ai virusului).

Informațiile false sunt diseminate printr-un mecanism relativ simplu, dar eficient. O operațiune de tip „Matryoshka” implică, la debut, un număr de 3 până la 5 „seeders” care postează inițial conținutul „fake” pe rețeaua de socializare folosită ca mediu de diseminare. Conținutul „fake” poate fi identic în redactare și informația falsă furnizată, dar poate să prezinte, la fiecare dintre „seeders”, anumite caracteristici individuale, fără a afecta substanțial informația falsă diseminată.

După aproximativ 30-45 minute, conțintul postat de fiecare dintre „seeders” este redistribuit de câte 3-5 „quoters”. Repostarea conținutului inițial se face fie în grupuri ale rețelei de socializare formate din membri ai grupului-țintă, fie sub formă de comentarii pe paginile/conturile unor entități mass-media, personalități politice, civice și comunități de „fact-checking” care sunt ținte sau medii supilmentare de diseminare pentru inițiatorii operațiunii „Matryoshka”.

Acțiunile acestor „quoters” durează câteva ore (între 3 și, uneori, 10 ore), iar conținutul distribuit, deși păstrează conținutul inițial, este individualizat în funcție de mediul de diseminare, fiind completat cu diferite texte, emoji ori cu „tag” pe ținta vizată (dacă este vorba de entități mass-media, personalități politice, civice și comunități de „fact-checking”). Frecvența postărilor/comentarilor făcute de „quoters” este de aproximativ o postare/comentariu pe minut.

Evident, numărul de „seeders” și „quoters” implicați este determinat de mărimea, complexitatea și obiectivele campaniei. O campanie masivă de dezinformare poate implica zeci de persoane reale implicate, precum și zeci de mii de „boți” coordonați prin intermediul unor softuri speciale.

În monitorizarea efectuată de VIGINUM au fost identificate erori care cel mai probabil nu s-ar fi produs dacă procesul ar fi fost automatizat (prin utilizarea de boți), fapt care confirmă că la nivelul acestei etape a operațiunii, care presupune folosirea de „quoters”, sunt implicate persoane reale.

Principalele erori identificate au fost:

- utilizarea de către un „quoter” a textului altui „quoter” în timpul aceleiași operațiuni;

- utilizarea unor etichete eronate în postările anumitor „quoters”;

- greșeli de scriere în unele postări ale „quoters”;

- citate într-un fir de comentarii și nu într-un răspuns la postarea unei persoane vizate.

O altă caracteristică a acțiunilor realizate de „quoters” este aceea că, dacă situația o cere, un „quoter” se transformă în „seeder”, persoanele din spatele conturilor respective (conturi false) abordând modalități specifice de distribuire a conținutului fals, în funcție de calitatea utilizată („quoter” sau „seeder”).

Conturile folosite în rețeaua de socializare selectată ca mediu de diseminare sunt conturi false, confecționate de firme specializate în „farmare” (creare în cantități industriale) de conturi în rețele de socializare, cu puțin timp înainte de declanșarea operațiunii de dezinformare de tip „Matryoshka”.

Conturile respective nu menționează o biografie/o locație (sau folosesc informații false în redactarea acestora), folosesc la profil imagini generate digital, au un număr redus de „prieteni” virtuali și/sau de abonați.

În completare, echipele de coordonare a unei operațiuni de tip „Matryoshka” se folosesc uneori de adrese de e-mail pentru a invita entități mass-media, personalități politice, civice și comunități de „fact-checking” să lectureze conținut online pe Telegram sau pe web-site-uri din ecosistemul de dezinformare, pentru a atrage atenția țintelor-cheie asupra conținutului fals diseminat în cadrul operațiunii.

Inteligența artificială, fermele de „boți” operate de Rusia și operațiunile de tip „Matryoshka” – o evoluție înspăimântătoare

Să ne oprim, deocamdată, din prezentarea analizei realizată de VIGINUM cu privire la modul de operare a Rețelei „Matryoshka” și să discutăm despre eficientizarea cu ajutorul inteligenței artificiale (AI) a acțiunilor de dezinformare lansate de fermele de „bots”.

În iulie 2024, Departamentul de Justiție al SUA, împreună cu omologii săi din Canada și Olanda, au dezactivat o fermă de „bots” rusească care răspândea propagandă pro-rusă. În cadrul acelei acțiuni, s-a evidențiat utilizarea AI-ului pentru a crea și opera ferma de „boți” respectivă, acest fapt constituind o evoluție înspăimântătoare în utilizarea inteligenței artificiale.

Într-un comunicat de presă intitulat „Departamentul de Justiție conduce eforturile partenerilor federali, internaționali și din sectorul privat pentru a desființa o fermă de roboți de socializare sub acoperire, operată de guvernul rusesc”, oficialii americani informează că „rețeaua de știri RT, condusă de statul rus, a dezvoltat și a operat o fermă de roboți îmbunătățită cu inteligență artificială pentru a disemina dezinformare și a semăna discordie în Statele Unite și în alte părți”.

Departamentul de Justiție american a confiscat două nume de domeniu și a analizat 968 de conturi de socializare folosite de actori ruși pentru a crea o fermă de „boți” de socializare cu inteligență artificială, care răspândea dezinformare în Statele Unite și în străinătate. Ferma de „boți” de socializare a folosit elemente de inteligență artificială pentru a crea profiluri de socializare fictive – adesea pretinzând că aparțin unor persoane din SUA –, pe care operatorii le-au folosit apoi pentru a promova mesaje în sprijinul obiectivelor Guvernului rus.

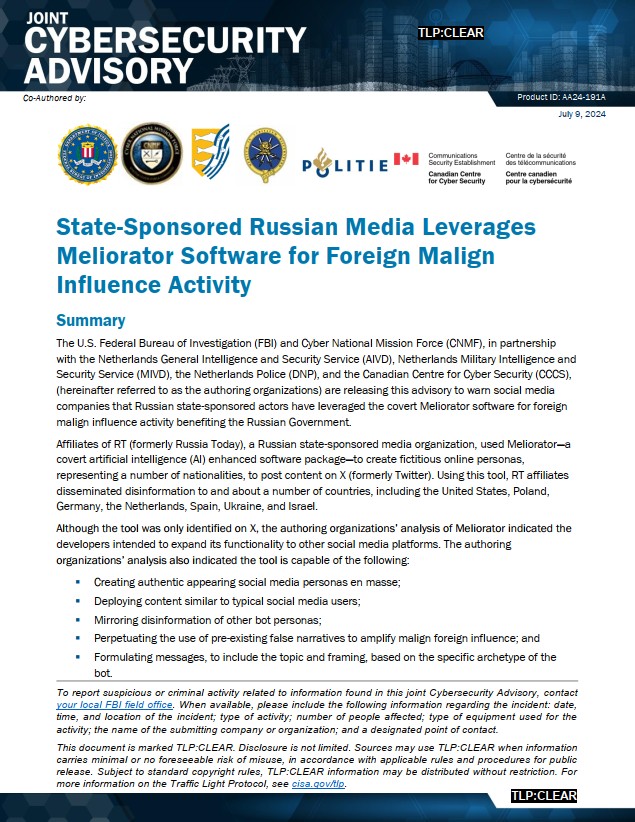

Tot în iulie 2024, Departamentul de Justiție american, FBI și Forța Națională de Misiune Cibernetică (CNMF), în parteneriat cu Centrul Canadian pentru Securitate Cibernetică (CCCS), Serviciul General de Informații și Securitate al Olandei (AIVD), Serviciul Militar de Informații și Securitate al Olandei (MIVD) și Poliția Olandeză, au emis un Aviz Comun de Securitate Cibernetică (ACSC). Acesta detaliază tehnologia din spatele fermei de boți de socializare, inclusiv detalii despre modul în care creatorii fermei de boți și-au folosit sistemul de inteligență artificială personalizat pentru a promova schema. Avizul permite platformelor de socializare și anchetatorilor să identifice și să prevină utilizarea în continuare a tehnologiei de către Guvernul rus.

Avizul Comun de Securitate Cibernetică avertizează companiile de social media că actori sponsorizați de statul rus au folosit software-ul Meliorator pentru activități de influență malignă străină în beneficiul Guvernului rus.

Afiliații RT (fosta Russia Today), care este o organizație media sponsorizată de statul rus, au folosit Meliorator – un pachet software sub acoperire, îmbunătățit cu AI – pentru a crea personaje online fictive, reprezentând o serie de naționalități, pentru a posta conținut pe X (fosta Twitter). Folosind acest instrument, afiliații RT au răspândit dezinformări către și despre o serie de țări, inclusiv SUA, Polonia, Germania, Olanda, Spania, Ucraina și Israel.

În ACSC se precizează că, deși instrumentul a fost identificat doar pe rețeaua de socializare X, analiza Meliorator a indicat că dezvoltatorii intenționau să extindă funcționalitatea acestuia la alte platforme de socializare.

Analiza a indicat, de asemenea, că instrumentul este capabil de următoarele:

- crearea în masă de personaje de socializare cu aspect autentic;

- implementarea de conținut similar cu cel al utilizatorilor tipici de socializare;

- oglindirea dezinformării altor personaje de boți;

- perpetuarea utilizării unor narațiuni false preexistente pentru a amplifica influența străină malignă;

- formularea de mesaje, care să includă subiectul și încadrarea, bazate pe arhetipul specific al bot-ului.

Câteva detalii tehnice despre acest instrument de administrare a fermelor de „boți”.

Rețeaua de știri RT, controlată de Guvernul Rusiei, a avut acces la Meliorator începând cu anul 2022. Meliorator este un software de generare și gestionare a fermelor de boți bazate pe inteligență artificială, pentru a disemina dezinformări către și despre o serie de țări, inclusiv SUA, Polonia, Germania, Olanda, Spania, Ucraina și Israel.

Software-ul Meliorator a fost conceput cu scopul de a fi utilizat pe rețelele de socializare pentru a crea în masă personaje cu aspect „autentic”, permițând propagarea dezinformării, ceea ce ar putea ajuta Rusia să exacerbeze discordia și să încerce să modifice opinia publică ca parte a operațiunilor informaționale.

Începând cu iunie 2024, Meliorator funcționa doar pe X (cunoscut anterior ca Twitter), însă analize suplimentare sugerează că funcționalitatea software-ului poate fi extinsă și la alte rețele de socializare.

Meliorator include un panou de administrator numit „Brigadir” și un instrument de seeding numit „Taras”, cu ajutorul cărora softul poate fi folosit la un randament maxim.

„Brigadir” este interfața principală pentru utilizatorul final al Meliorator și funcționează ca panou de administrare. Totodată, „Brigadir” este interfață grafică pentru aplicația „Taras” și include fișiere pentru „suflete” (identitățile false care creează baza pentru „boți”) și fișiere pentru „gânduri”. Aceste „gânduri” sunt scenarii sau acțiuni automate care pot fi implementate în numele „boților”, cum ar fi partajarea de conținut pe rețelele de socializare.

„Taras” servește ca „back-end” al pachetului software Meliorator și conține fișiere .json utilizate pentru a controla persoanele care răspândesc dezinformare pe rețelele de socializare. Aceste fișiere sunt cod extrem de descentralizat, care trebuie combinat cu alte fișiere la execuție pentru a obține funcționalitatea dorită. Două fișiere specifice sunt vitale pentru funcționalitatea Taras. Primul fișier este conceput pentru a agrega o serie de alte instrumente și baze de date pentru utilizarea lor, iar al doilea fișier este conceput pentru a agrega și executa o serie de instrumente de automatizare utilizate de Meliorator.

Fișierul „Suflete” conține identitățile false. Aceste așa-numite „suflete” ale „boți”-lor folosiți sunt determinate pe baza selecției unor parametri specifici sau arhetipuri selectate de utilizatorul softului Meliorator. Orice câmp nepreselectat va fi generat automat. Arhetipurile de boți sunt apoi create pentru a grupa boții aliniați ideologic folosind un algoritm special conceput pentru a construi persona fiecărui „bot”, determinând locația, ideologiile politice și chiar datele biografice ale personei. Aceste detalii sunt completate automat pe baza selecției arhetipului sufletelor. Odată ce „Taras” creează identitatea, aceasta este înregistrată pe platforma de socializare. Identitățile sunt stocate folosind un „MongoDB”, care poate permite interogări ad-hoc, indexare, echilibrare a încărcării, agregare și execuție JavaScript pe server.

Fișierul „Gândurile” conține scenarii sau acțiuni automate care pot fi finalizate în numele unui „suflet” sau al unui grup de „suflete”. Acest lucru permite persoanelor să aprecieze, să partajeze, să reposteze și să comenteze postările altora cu videoclipuri sau link-uri. Fișierul „Gânduri” permite, de asemenea, întreținerea, crearea unei noi înregistrări pentru o identitate și conectarea la profiluri deja existente. Cadrul pentru fișierul „Gânduri” și scenariile pe care le creează poate fi văzut în cod; aceste fișiere sunt scrise separat, iar un fișier-părinte apelează la fișiere mai mici pentru a îndeplini funcția. În mod special, același cod conține referințe la alte platforme de socializare, inclusiv Facebook și Instagram, indicând intenția de a extinde proiectul dincolo de X.

Operatorii „Taras” folosesc fișierul „Gânduri” pentru a se conecta la personajele deja existente din ferma de boți. Odată ce un „suflet” este activ pe platforma de socializare, „cartea de identitate” a personajului prezintă un ecran de conectare pentru platforma de socializare.

Caracteristicile boților sunt atent stabilite de către specialiștii Guvernului Rusiei care operează softul Meliorator. Astfel, pentru a evita detectarea în cursul activității online, fiecare cont de bot este creat având în vedere una dintre cele trei funcții diferite. Folosind fișierul „Suflete”, persoana este generată pentru arhetipuri specifice care apoi rămân ale „bot”-ului pe toată durata sa de funcționare.

Primul arhetip de bot primește profiluri complete constând dintr-o fotografie de profil, o fotografie de copertă și date biografice, inclusiv numele și locația. Acești boți au, de asemenea, mici biografii care indică înclinațiile sau ideologiile lor politice. Dacă un bot are aceste informații, va fi folosit intens pentru a propaga informații și va desfășura cea mai robustă activitate. Fotografiile de profil pentru boți au fost generate folosind tehnologii de AI (cea mai accesibilă fiind „text-to-photo”). În speța studiată și prezentată de Avizul Comun de Securitate Cibernetică (ACSC), a fost folosit un instrument „open source” numit „Faker” pentru a genera fotografii, informații biografice și alte detalii.

Un al doilea arhetip de bot conține foarte puține informații despre profilul său, dacă cumva aceste informații sunt prezentate. De obicei, profilul constă dintr-un nume de utilizator și foarte puțin conținut original și este folosit pentru a da „like” informațiilor false deja partajate.

Arhetipul final de bot a fost creat folosind date compilate de un „webcrawler” asociat cu site-ul Nemezida (varianta nemez1da) sau de alte depozite de date pentru a crea o persoană autentică fără legături cu AI. Acest bot pare real prin generarea unei activități numeroase și prin acumularea de urmăritori. Dintre toate arhetipurile de bot, această „personaj-bot” pare cel mai legitim și este folosit pentru a oglindi și amplifica dezinformările partajate de conturile de bot și non-bot.

Avizul Comun de Securitate Cibernetică (ACSC) a observat un efort constant de sofisticare a confecționării și utilizării bots-ilor prin utilizarea AI.

Astfel, conturile de „personaj-bot” fac încercări evidente de a evita interdicțiile pentru încălcarea termenilor și condițiilor de utilizare și de a evita să fie remarcate ca boți, prin integrarea în mediul mai larg al rețelelor sociale.

Majoritatea conturilor de „personaje-bot” se lăudau cu peste 100.000 de urmăritori, număr necesar pentru ca o „persoană-bot” să evite detectarea atunci când interacționează cu alte conturi (deținute de persoane reale).

Totodată, la fel ca și conturile autentice, „boții” urmăresc conturi autentice care reflectă înclinațiile și interesele lor politice enumerate în biografia lor confecționată. Excepțiile de la regula celor 100.000 de urmăritori au inclus urmărirea conturilor altor boți și/sau a conturilor extrem de mediatizate pe care o persoană interesată de politica SUA ar avea sens să le urmărească, cum ar fi politicienii cunoscuți.

Avizul Comun de Securitate Cibernetică (ACSC) atenționează că instrumentul Meliorator folosit de Rusia pentru administrarea boților este capabil să primească și să răspundă la mesaje directe, dar că în general încearcă să evite acest lucru pentru a limita nevoia de a răspunde în timp real.

În urma analizelor realizate, Avizul Comun de Securitate Cibernetică (ACSC) arată că personajele-bot identificate și asociate cu instrumentul Meliorator sunt capabile de următoarele:

- implementarea de conținut similar cu cel al utilizatorilor tipici de social media, cum ar fi generarea de postări originale, urmărirea altor utilizatori, „like-uri”, comentarea, repostarea și obținerea de urmăritori;

- oglindirea dezinformării altor personaje-bot prin mesajele, răspunsurile, repostările și biografiile lor;

- perpetuarea utilizării unor narațiuni false preexistente pentru a amplifica dezinformarea rusească;

- formularea de mesaje care să includă subiectul și cadrul, bazate pe arhetipul specific al bot-ului.

Creatorii instrumentului Meliorator au luat în considerare o serie de bariere în calea detectării și au codat capacitatea de a ascunde IP-ul, de a ocoli autentificarea cu factor dublu și de a modifica șirul agentului utilizator. Operatorii Meliorator evită detectarea utilizând un cod „backend” conceput pentru a atribui automat o adresă IP proxy personajului-bot generat de AI, pe baza locației lui presupuse (false). Dezvoltatorul a scris o porțiune de cod pentru a verifica și a vedea dacă un proxy și un port specific se află într-un MongoDB specificat în același cod. Dacă nu, acesta găsește un IP activ deschis, având în vedere o valoare a codului de țară.

În cazul rețelei de socializare X, Avizul Comun de Securitate Cibernetică (ACSC) a descoperit că, pentru a ocoli măsurile implementate de X pentru a preveni funcționalitățile boților, dezvoltatorul Meliorator a introdus un cod care permite serverului să ocolească metodele de verificare X. Mai exact, atunci când rețeaua de socializare X trimite un cod de autentificare către un cont, e-mailul este trimis direct către server (deoarece e-mailul asociat contului se află pe același server), codul răspunde prin extragerea codului de verificare și răspunzând către X cu acesta. Deși acest instrument este codificat special pentru X, este ușor de adaptat la orice platformă de socializare care se bazează pe o structură de autentificare similară.

Totodată, dezvoltatorul Meliorator a modificat șirul de caractere al agentului utilizator, astfel încât șirul de caractere al agentului utilizator pentru fiecare identitate a botului va fi același. Înainte de a face acest lucru, activitatea a fost setată să utilizeze un port de depanare la distanță pentru a ascunde complet sarcina.

Softul Meliorator, prin intermediul căruia fermele de boți sunt create și puse în funcționare cu ajutorul AI, reprezintă un instrument sinistru, folosit cu o eficiență nemaiîntâlnită până în prezent de Rusia lui Putin pentru a influența opinia publică din statele-țintă, unde este diseminată dezinformarea confecționată de aparatul de propagandă și serviciile secrete ale Rusiei.

Un soft pentru care Lumea Liberă nu este pregătită…

O concluzie de etapă – trebuie să reformăm Serviciile secrete, dar cum facem asta?

România este lipsită de apărare în fața operațiunilor de tip „Matryoshka” și a campaniilor de dezinformare lansate în rețelele de socializare de fermele de boți administrate cu ajutorul unor softuri ca Meliorator.

Serviciile secrete românești – subvenționate mai mult decât generos de la bugetul statului român – sunt total depășite de noile tehnologii folosite de Rusia (și nu numai) în războiul hibrid declanșat împotriva Lumii Libere.

La acest moment se fac eforturi mari pentru ca serviciile secrete ale statului român să-și actualizeze strategiile, tehnologia și mai ales viziunea asupra modalităților de susținere a „războiului nevăzut” pe care Lumea Liberă îl poartă împotriva dictaturilor din Rusia, China, Iran, Coreea de Nord și a trădătorilor și idioților utili din slujba acestor inamici declarați ai democrației euro-atlantice.

Nu știm dacă reforma serviciilor secrete românești va fi una de succes, mai ales că factorul decident (politic) se află într-o mare eroare, considerând că această reformă trebuie să fie una administrativă, orientată mai mult pe mecanismele de management și mai puțin pe activitatea informativă specifică.

O reformă strict administrativă, de management, ar fi nimic altceva decât o reașezare a intereselor de natură politică pe care partidele și clanurile mafiote din politica românească le au în dobândirea controlului asupra activității serviciilor secrete românești. Altfel spus, dezastrul nu va fi oprit, ci – dimpotrivă – agravat.

Evident, sunt foarte importante calitatea profesională și nivelul de onestitate în cazul persoanelor care sunt mandatate să conducă SRI/SIE/DGIA/STS, însă acesta este abia începutul – necesar, dar nu și suficient.

La fel de importantă este eficientizarea structurii interne și a mecanismelor de gestionare a informațiilor specifice serviciilor secrete, dar iarăși: deși necesar, acest demers nu este și suficient.

Fără să anticipăm (în partea a doua a analizei noastre vom discuta în detaliu), spunem că una din cauzele înfrângerii dezastruoase a serviciilor secrete românești de către serviciilor secrete ale Rusiei este precaritatea pregătirii profesionale a specialiștilor serviciilor secrete românești în domeniile specifice „războiului hibrid” și, cu precădere, a operațiunilor de manipulare în spațiul virtual.

Pur și simplu, serviciile secrete românești sunt rămase în urmă, mizând mai mult pe calitățile individuale de „James Bond” deținute de ofițerii și agenții de teren și mai puțin pe importanța decisivă a noilor tehnologii cu care operează în spațiul virtual, dar și în lumea reală, serviciile secrete ale unor țări potențial sau declarat inamice Lumii Libere, din care România face parte.

Despre capacitatea de analiză și predicție a serviciilor secrete românești, probabil că este inutil să mai discutăm. Apariția unor trădători în slujba Rusiei, ca George Simion și Călin Georgescu, a luat efectiv prin surprindere echipele de analiști ale serviciilor secrete românești, în ciuda faptului că au existat suficiente semnale că acești indivizi sunt un pericol potențial major pentru statul român și pentru apartenența României la Uniunea Europeană și NATO.

Reformarea reală a serviciilor secrete românești reprezintă una dintre marile provocări la care trebuie să răspundă președintele Nicușor Dan și actualul guvern, condus de liberalul Ilie Bolojan. De acest răspuns depinde soarta României în „războiul hibrid” pe care Rusia și alte dictaturi (precum China) îl poartă împotriva noastră și a Lumii Libere.

O nouă înfrângere a serviciilor secrete românești, așa cum s-a întâmplat în dosarele George Simion și Călin Georgescu, ar accelera mortal prăbușirea democrației în România…

(Va urma)

„justitie” CU PREMEDITARE:

„Dosarul omului de afaceri Cristian Burci, în pragul prescrierii: Colegiul de conducere al Curții de Apel București a înlocuit judecătorul din complet cu consecința reluării procesului de la zero”

UN NOU SUCCES PENTRU cab ? CEVA PRIVILEGII NOI, NU ?

SA-L PARAFRAZAM PE dragnetti:

„justitie” ZERO. DE LA ZERO.

SINGURUL PROIECT PENTRU romania EXECUTAT CU MAXIMA DETERMINARE, PRECIZIE SI UNIUNE ESTE: „SCAPAM TOTI, RAMANEM CU TOT CE AM FURAT, NE DAM LEGI SA NU MAI PUTEM FI PEDEPSITI SI NE LUAM TOATA PUTEREA ADICA ‘justitia’